2026年4月16日,Anthropic正式发布了新一代旗舰大模型Claude Opus 4.7。从官方公布的数据来看,这次更新的力度远超市场预期——视觉识别准确率从54.5%飙升至98.5%,生产代码任务完成量是上代的3倍,编码评估解决率整体提升13%。这款被业界视为”AGI最后冲刺”的新模型,究竟带来了哪些突破?

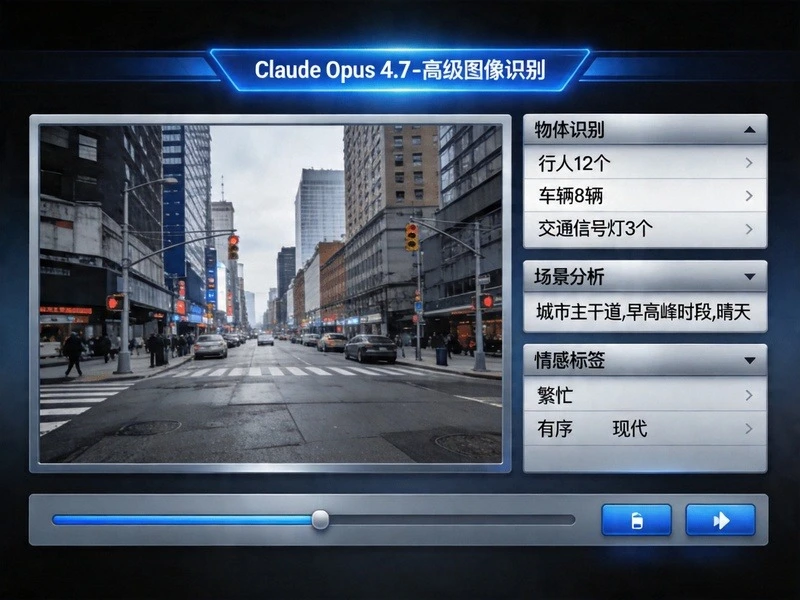

视觉能力:从”能看”到”看懂”的质变

如果要从Opus 4.7的诸多升级中挑选最亮眼的一项,视觉能力的飞跃当之无愧。

Anthropic在官方公告中专门提到了XBOW视觉敏锐度基准测试。Opus 4.6在这项测试中的得分是54.5%,而到了Opus 4.7,这一数字直接跳到了98.5%。这个提升幅度,放在AI模型的迭代历史里都算得上罕见。

从具体能力来看,Opus 4.7支持最高约375万像素的图像输入,长边最长可达2576像素,是上一代的3倍以上。这意味着什么?如果你给它一张密密麻麻的复杂截图,或者一张包含大量数字的财务报表,它不仅能看清每一个细节,还能准确提取和理解其中的信息。

对于需要处理设计稿、产品原型、复杂文档的用户来说,这一次升级几乎等于打开了一扇新门。设计师可以直接上传整张设计稿询问布局问题,产品经理能够一键解析原型图的结构逻辑,财务人员可以快速提取报表中的关键数据。

编程能力:从”辅助工具”到”代码伙伴”

另一个让开发者兴奋不已的突破,是Opus 4.7在软件工程方向的全面提升。

官方给出的测试数据极具说服力:在CursorBench测试中,Opus 4.7的得分从58%提升到70%,进步了12个百分点;在Rakuten-SWE-Bench测试中,它完成的生产任务数量是Opus 4.6的3倍;在涵盖93项编码任务的综合基准中,解决率提升了13%,其中有4项任务是Opus 4.6和Sonnet 4.6都无法完成的,这次被成功攻克。

Anthropic在公告中用一个案例来说明Opus 4.7的能力上限:它自主构建了一个完整的Rust语言文字转语音引擎,包含神经网络模型、SIMD内核优化,还配了一个可以运行在浏览器里的演示程序,最后用语音识别器自己验证输出结果是否正确。公司评价称,这相当于一位高级工程师几个月的工作量。

当然,这类描述在AI公司的发布稿中并不罕见,实际使用效果因人而异。但从第三方测试数据来看,Opus 4.7的编程能力确实迈上了一个新台阶。

指令遵循:更严格带来的”甜蜜烦恼”

Opus 4.7在指令遵循方面也有显著改善。简单来说,用户说什么,模型就做什么,不会自作主张地跳过步骤或宽松解释意图。

但这里有一个需要留意的地方:Anthropic专门在发布文档中提醒用户,之前针对Opus 4.6编写的提示词,在4.7上可能会产生意想不到的结果。原因正是指令遵循更严格了——旧版本会灵活变通甚至忽略的指令,新版本会一字不差地执行,反而可能导致输出与预期不符。如果开发者正在使用API,切换到4.7之前最好重新检查和调整一下提示词。

这个”副作用”看似麻烦,实际上反映的是Anthropic对模型可控性的极致追求。更严格的指令遵循,意味着AI的行为更加可预测,更适合在对准确性要求严苛的生产环境中部署。

记忆能力:长任务终于”靠得住”

在多会话的长期工作场景中,Opus 4.7的记忆能力也得到了实质性改进。它更擅长利用基于文件系统的记忆机制,能在跨越多次对话的长时间工作中记住关键信息,下次启动任务时不需要重新交代大量背景。

这对于需要AI持续参与的项目型工作尤为实用。比如一个持续推进几周的代码项目,或者需要多次迭代的长篇文档撰写工作,每次重新打开对话时,不必再把上下文背景重新粘贴一遍,AI已经自动”记住”了。

Claude Code同步升级:新增代码超级审查

与Opus 4.7同步发布的,还有一系列Claude Code(面向开发者的编程工具)更新。

最引人注目的是新增的”/ultrareview”指令。开启这个模式后,Claude会以”专业代码审查员”的视角通读整个代码改动,标记出技术审核人员会关注的问题,而不仅仅是表面的语法错误或风格问题。Pro版和Max版用户每月可以免费使用3次。

此外,之前只对团队版和企业版用户开放的”自动模式”(Auto模式),这次正式向Max订阅用户开放。在这个模式下,Claude可以自主做出更多决策,减少频繁打断用户确认的次数,同时比完全跳过权限控制的模式更加安全可控。

安全机制:Project Glasswing的首款落地产品

Opus 4.7是”Project Glasswing”计划下第一款应用新网络安全保障措施的模型。训练过程中,Anthropic专门尝试削弱模型在网络攻击方向的能力,同时部署了自动检测高风险网络安全请求的拦截机制。

如果是有合法需求的安全专业人员,可以通过新推出的”Cyber Verification Program”(网络安全验证计划)申请使用相关功能,绕过部分限制。

这一机制背后折射出一个现实:随着AI模型能力越来越强,如何防止它被用于网络攻击,已经成为主流AI公司必须面对的课题。Anthropic选择了一种更为审慎的路径——既保证模型能力的领先,又为高风险能力设置了专门的”阀门”。

定价:维持不变,但分词器有变化

对于开发者来说,一个好消息是:Opus 4.7的定价与上代完全相同——输入每百万token收费5美元,输出每百万token收费25美元。

但有一个需要留意的变化:Opus 4.7换用了新的分词器,相同内容可能比之前消耗更多token,大约是原来的1.0到1.35倍。换句话说,名义上价格没变,但实际上同样的任务可能会花更多钱。Anthropic建议用户在实际流量中测量差异,并通过调整”effort”参数和任务预算来控制成本。

目前,Claude Opus 4.7可以通过Claude的所有产品线使用,也支持Amazon Bedrock、Google Cloud Vertex AI、Microsoft Foundry等云平台的API接入。

写在最后

Anthropic这次的发布时间点耐人寻味——就在谷歌、OpenAI都在加速发布新版本的当口,Opus 4.7选择了悄悄亮相,但用硬核数据说话。视觉能力近乎翻倍式的提升,加上编程任务3倍的效率增长,让它在当前这批主流模型中稳稳站住了旗舰级的位置。

对于开发者而言,这或许意味着一个全新的编程范式正在到来——当AI不仅能写代码,还能看懂设计稿、理解复杂图表、自主完成代码审查时,”AI编程助手”这个概念本身,正在被重新定义。

相关阅读:

发表回复