一、端侧AI:为什么现在迎来爆发期

回望过去几年,AI大模型的发展可以用”狂飙突进”来形容。参数规模从百亿飙升到万亿,上下文窗口从几千token扩展到百万级别,多模态能力从简单叠加走向原生统一。然而,这场盛宴几乎全部发生在云端——强大如GPT-5.4、Claude Opus 4.6,依然需要昂贵的服务器集群支撑。

这种模式的局限性显而易见:网络延迟、隐私风险、成本高昂、离线不可用。当用户期望在地铁里流畅使用AI助手、在汽车里实时处理语音指令、在工厂边缘设备上完成质量检测时,云端AI的短板暴露无遗。

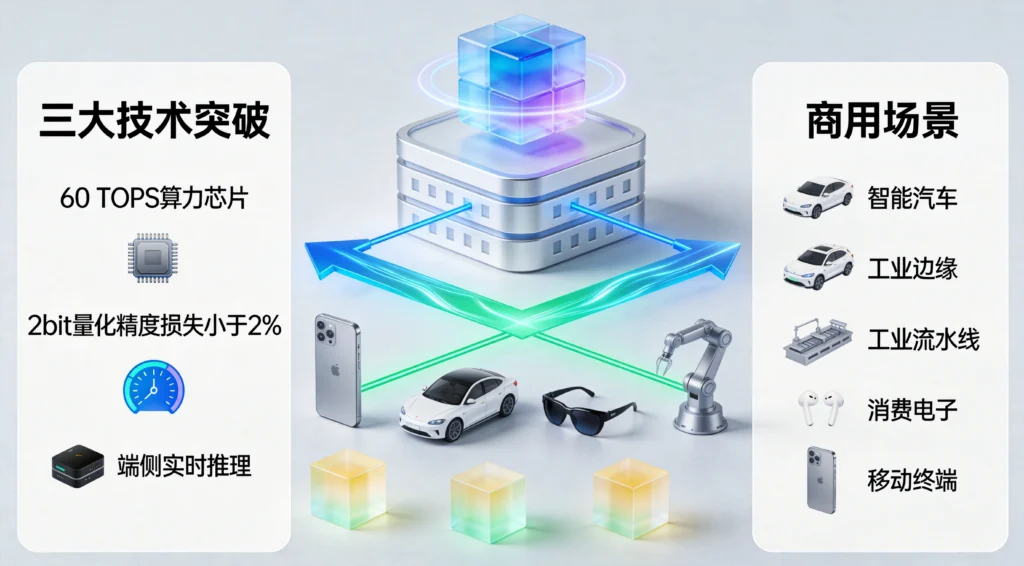

进入2026年,这一困境终于迎来转机。驱动端侧AI爆发的,是三股力量的合流。

第一股力量是硬件性能的跃升。 进迭时空在4月23日发布了全球首款量产RVA23规范RISC-V高端处理器K3 AI CPU芯片,集成60 TOPS AI算力,支持30B参数模型运行。这意味着在传统意义上需要服务器级别的算力,如今可以在巴掌大小的芯片上实现。更关键的是,RVA23规范意味着这款芯片拥有统一的AI扩展指令集,完美适配现代大模型的计算模式。

第二股力量是模型架构的革新。 以DeepSeek V4为代表的新一代大模型,采用Ultra-MoE稀疏激活架构,总参数量虽然达到万亿级别,但每次推理激活的参数仅需130亿左右。这种”大模型、小推理”的范式,让端侧设备终于有了承载AI能力的可能。同样采用MoE架构的GLM-4.7-Flash,总参数量30B,推理激活仅3B参数,推理速度提升40%,能耗降低35%。

第三股力量是量化技术的成熟。 2026年,2bit/1.5bit量化技术实现了边端化落地。在精度损失小于2%的前提下,端侧芯片可以实时运行大模型推理。这意味着不再是”能用”,而是”好用”——端侧AI终于可以在保证用户体验的同时,实现规模化部署。

二、技术突破:端侧多模态基座大模型Sage

在端侧AI的技术版图中,商汤绝影发布的Sage大模型是一个标志性事件。

Sage是全球首款端侧多模态智能体基座大模型,采用原生多模态架构设计。在PinchBench评测中,Sage的任务完成率高达94%,这意味着在真实的端侧应用场景中,Sage能够可靠地完成用户交给的任务。

为什么说Sage代表了端侧AI的技术高度?

首先,它解决了端侧设备最头疼的多模态融合问题。传统方案往往是”文本基座+视觉编码器”的拼接模式,不同模态之间是割裂的。Sage通过统一的Transformer/SSM混合架构,实现了文本、图像、视频、音频、时序传感器数据的统一编码与解码。这意味着在边端巡检场景中,Sage可以同时融合红外热成像的设备声音、传感器时序数据和现场视频,实现设备缺陷的精准识别与根因分析,综合识别准确率超过98%。

其次,Sage的端侧推理效率令人印象深刻。在传统的方案中,多模态模型往往需要大量的计算资源才能运行。Sage通过深度优化,在端侧设备上实现了”视觉-语音-文本”的端侧实时推理。在巡检机器人、车载终端等设备上,无需云端交互即可完成现场缺陷识别、语音指令交互、实时预警。

这种能力边界的外拓,意味着AI正在从”联网才能用”变成”随时随地可用”。对于工厂车间、山区基站、海上平台等网络受限场景,这可能是革命性的改变。

三、端云协同:混合计算架构的最优解

端侧AI的爆发,并非意味着云端AI的退场。恰恰相反,端云协同的混合计算架构正在成为2026年AI落地的主流范式。

一个典型的端云协同场景是这样的:

云端大模型负责模型训练、复杂推理、根因分析、决策优化、全局调度。比如能源集团的总部云端,部署千亿级MoE行业大模型,负责全集团的设备数据分析、生产策略优化、风险全局预警。

边缘/端侧小模型负责实时数据采集、现场推理、实时预警、本地控制。比如场站的巡检机器人、车间的边缘网关,部署轻量化多模态小模型,实现现场设备缺陷的实时识别、异常工况的即时预警,无需云端交互即可完成闭环处置。

云端大模型持续基于全集团的数据迭代优化,定期将能力蒸馏到端侧小模型,实现端侧模型的持续升级;端侧采集的现场数据,同步回传云端,为大模型迭代提供数据支撑,形成”数据-模型-应用-反馈”的全闭环。

这种架构的优势在于:让合适的事情发生在合适的地方。实时性要求高的任务交给端侧,复杂推理任务交给云端;保护隐私的数据在本地处理,需要全局视野的任务在云端完成;端侧积累的小样本回传给云端训练,持续提升模型能力。

四、商用落地:四大场景率先突破

端侧AI的规模化商用,正在四个场景率先突破。

场景一:智能汽车

4月22日,行业消息显示特斯拉车型车机语音系统将接入字节跳动豆包大模型与DeepSeekChat,两款模型均通过火山引擎接入。这标志着多模态大模型正式落地汽车端,实现了AI与物理出行场景的深度融合。

在汽车场景中,端侧AI的价值尤为突出。车机系统需要在隧道、地下停车场等网络不佳的环境中保持稳定响应,需要对驾驶者的语音指令实现毫秒级响应,还需要保护车内对话的隐私安全——这些都是云端AI的短板,端侧AI则可以完美解决。

场景二:工业边缘

在能源场站无人巡检场景中,端侧AI正在快速渗透。传统的巡检方案依赖人工定期巡查,不仅效率低下,还存在安全风险。采用端侧多模态小模型后,巡检机器人可以实时识别设备缺陷、异常工况,响应时间从分钟级压缩到毫秒级。

更重要的是,端侧方案解决了工业场景的网络痛点。工厂车间、山区基站、海上平台往往网络条件不佳,端侧AI让这些场景也能享受智能化带来的效率提升。

场景三:消费电子

4月,625亿数码国补政策落地,手机、平板、手表、智能眼镜等设备享受15%直减,最高补贴500元。政策的刺激叠加端侧AI能力的提升,智能眼镜销量同比增长42.4%,成为消费电子领域增长最快的品类。

端侧AI为消费电子带来的改变是体验层面的。以智能眼镜为例,本地运行的AI助手可以实现实时翻译、物品识别、导航指引等功能,用户无需掏出手机、无需等待网络响应,AI能力成为眼镜的”原生能力”而非”联网功能”。

场景四:移动终端

根据公开数据,2026年一季度国内AI原生APP月活已达4.4亿,豆包、千问、DeepSeek分列前三。这些应用的爆发,离不开端侧AI能力的支撑。当AI助手需要处理用户的日常对话、查询、创作需求时,端侧处理可以大幅降低响应延迟,提升用户体验。

五、技术挑战:精度、效率与安全的三角博弈

端侧AI的规模化落地并非一帆风顺。开发者需要在精度、效率、安全三个维度之间找到平衡点。

精度挑战是最直观的问题。端侧设备的算力、内存、功耗都有严格限制,量化压缩是必要手段,但会带来精度损失。2026年的技术突破已经将这种损失控制在2%以内,但对于某些高精度要求的场景(如医疗诊断),这个数字依然难以接受。

效率挑战体现在实时性要求上。工业场景的缺陷检测、自动驾驶的障碍物识别,都需要毫秒级响应。端侧模型需要在保证精度的同时,实现足够快的推理速度。多步自洽投机解码技术的成熟,让端侧推理速度提升了2-4倍,但更复杂的场景依然需要进一步优化。

安全挑战是端侧AI特有的难题。当AI能力下沉到终端设备,数据的安全性如何保障?模型是否会被恶意篡改?端侧推理的结果如何验证?这些问题都需要在架构设计层面加以考虑。

六、未来展望:端侧AI的下一个五年

展望未来,端侧AI的发展将呈现三个趋势。

趋势一:模型能力的持续下沉

随着芯片算力的提升和模型架构的优化,能够在端侧运行的模型规模将持续扩大。预计到2027年,百亿参数级别的模型将成为主流端侧设备的标配。更强的端侧能力,意味着更多复杂的AI任务可以在本地完成,减少对云端的依赖。

趋势二:端云边界的动态调整

端侧AI和云端AI的关系并非固定不变,而是会根据具体场景动态调整。一个可能的方向是”任务感知的资源调度”——AI系统会根据任务的复杂度、网络条件、隐私要求,自动选择最优的执行位置。简单查询由端侧处理,复杂推理交给云端,隐私敏感的数据本地处理,需要全局视野的任务上传云端。

趋势三:生态格局的重塑

端侧AI的爆发将重塑整个AI产业的价值链。芯片厂商的重要性进一步提升,端侧推理框架成为新的战场,应用开发者获得了更大的创新空间。在这场变革中,能够提供”端-边-云”一体化解决方案的厂商,将占据优势地位。

结语

端侧AI的规模化元年,标志着一个新时代的开启。

当AI能力从云端下沉到每一个终端设备,当每一次交互都可以在毫秒级完成,当隐私敏感的数据不再需要上传云端——我们正在经历的,不仅是技术的进步,更是人机交互范式的根本性变革。

这场变革的参与者,不仅是技术厂商和芯片公司,更是每一个普通用户。当你的手机、汽车、眼镜、手表都具备了”思考”的能力,当AI真正成为随时随地可用的基础设施,我们与数字世界的关系将被彻底改写。

2026年,注定是端侧AI发展史上值得铭记的一年。

本文系AI行业门户原创内容,引用请注明来源。

发表回复