一、从”感知”到”决策”:AI风险正在升级

2026年4月14日,2026世界互联网大会亚太峰会在香港举行。在”人工智能安全治理论坛”上,多国与会人士围绕AI治理思路、技术风险防范、国际协作机制等议题展开交流。

中国工程院院士、中关村实验室主任、清华大学讲席教授吴建平在论坛上直言:“AI安全治理不仅是技术问题,更是战略抉择,需在创新与规范、发展与安全间找到动态平衡。”

这个判断背后有一个深刻的背景:AI正在从”感知智能”迈向”决策智能”。

过去几年,AI主要扮演”助理”的角色——帮你写文案、画图、回答问题。这些任务的结果往往是可逆的,即使出错,后果也相对有限。但当AI开始做出决策——自动驾驶、手术机器人、金融交易——风险就完全不同了。一旦出错,后果可能是致命的。

风险正在复杂化、智能化、隐蔽化。

清华大学计算机系教授、科研院院长、技术转移院院长、互联网司法研究院院长刘奕群提出了一个关键洞察:”安全需要被精准度量,没有科学严谨的评测机制,人工智能大模型安全治理便无从谈起。”

他主张以场景化测试赋能人工智能安全,以”评测即治理”的思路破解大模型安全治理难题。这意味着,安全治理不能只靠抽象的原则,还需要针对具体场景设计可量化的评测标准。

中科院计算所副所长程学旗则提出了以”可信、可监管、可控”为核心的治理框架,推动AI安全从”超级对齐”转向可测量的实践治理,通过数据透明、模型鲁棒、测试时推理三大技术方向,实现风险可观测、可恢复。

二、框架2.0:风险三分法与八项可信准则

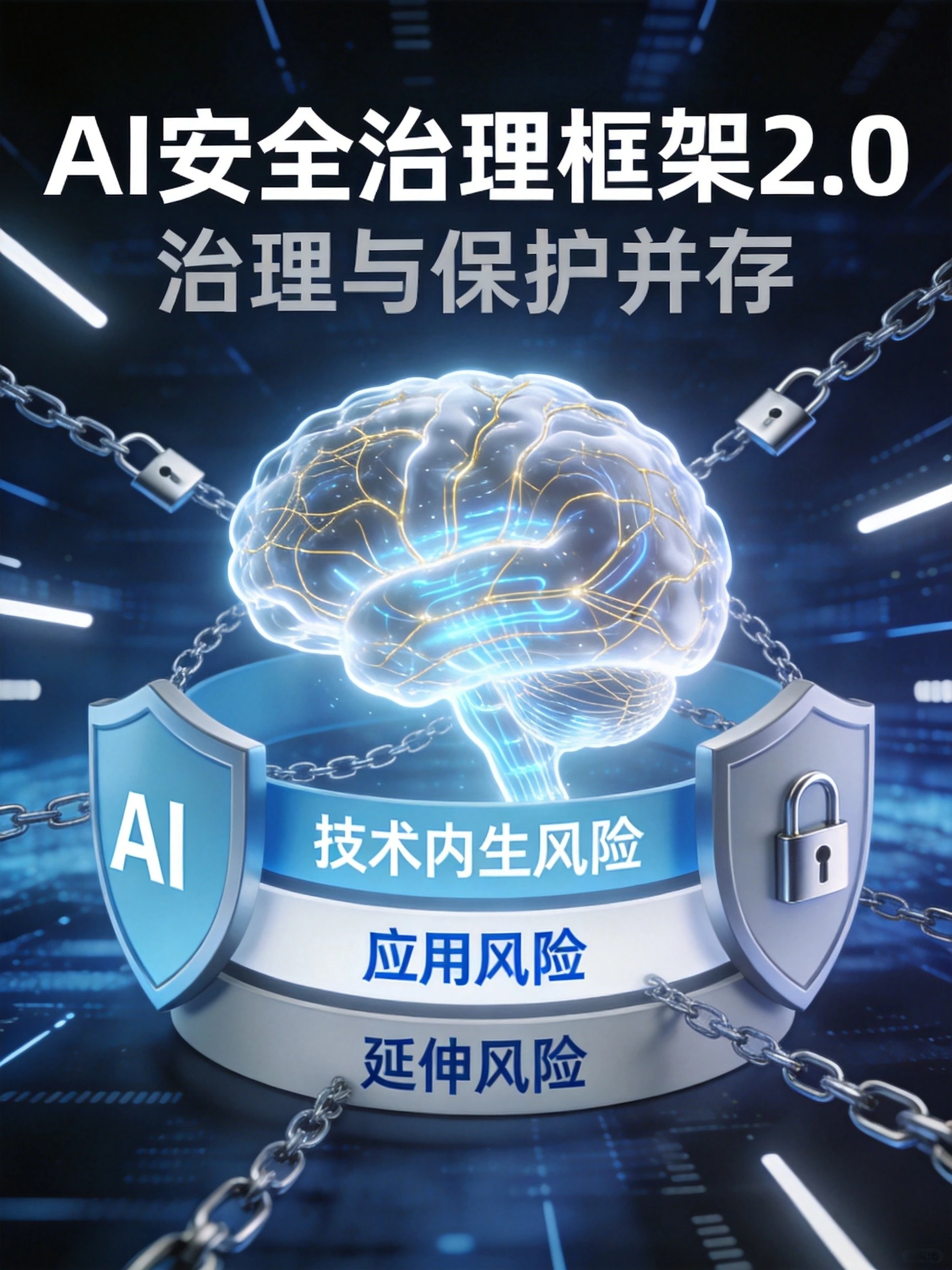

在本次论坛上,CNCert/cc处长贺敏正式发布了《人工智能安全治理框架2.0》。这一框架是理解当前AI安全治理走向的关键文件。

框架2.0的核心贡献是将AI风险分为三大类:

第一类是技术内生风险。 这类风险源于AI技术本身的特性,包括模型幻觉(生成看似合理但实际错误的内容)、对抗样本(通过精心设计的输入欺骗模型)、模型偏见(训练数据导致的歧视性输出)、隐私泄露(模型记忆并泄露训练数据中的敏感信息)等。

第二类是应用风险。 这类风险产生于AI在实际场景中的应用过程,包括自主决策失误(AI在无人监督下做出错误决策)、责任归属模糊(当AI造成损害时,谁该负责?)、人机协作失衡(人类过度依赖AI导致能力退化)等。

第三类是延伸风险。 这类风险是AI对社会、经济、政治等宏观层面的连锁影响,包括就业替代(AI取代人类工作的速度和规模)、信息操纵(AI生成虚假信息影响舆论)、军备竞赛(AI用于军事目的)等。

框架2.0还明确了人工智能分级分类原则——不是所有AI系统都需要同等程度的安全措施,一个垃圾邮件分类器和一个自动驾驶系统显然面临不同的安全要求,适用不同的治理标准。

八项可信准则则是对AI系统的基本要求:安全性、可靠性、可解释性、公平性、隐私保护、责任清晰、透明可追溯、人类控制。

三、智能体时代:安全治理范式需要升级

香港科技大学助理教授、香港生成式人工智能研发中心主任特别助理及大模型部主任韩斯睿在论坛上提出了一个警示:“智能体已成为社会信息网络的’行动者’,风险将从单点失误演变为协同放大。”

这个判断点出了当前AI安全治理面临的核心挑战:传统安全治理范式是针对”工具”设计的,而AI Agent正在成为”行动者”。

当一个AI系统能够自主规划目标、调用工具、与其他AI系统协作、并在过程中不断学习进化时,传统的安全边界正在被打破。

深信服科技集团股份有限公司副总裁杜智伟主张为AI打造”安全刹车系统”,以零信任管控、最小权限、熔断机制,平衡行业应用中的安全与生产力需求。

德国赫尔蒂行政学院数字治理中心研究员、中国科学院访问教授托尔斯滕·耶利内克则认为,AI治理重心要从”模型对齐”走向”系统对齐”,管控工具权限、执行逻辑与运行环境,以端到端防护守住系统安全。

模型对齐(Alignment) 是过去几年AI安全研究的核心议题,目标是确保AI系统的行为符合人类意图。但耶利内克的观点提示我们,即使单个模型是”对齐”的,由多个AI Agent组成的系统仍然可能产生意想不到的风险——就像单个蚂蚁的行为可以预测,但蚁群的行为往往出人意料。

四、企业视角:无安全不智能

面向产业应用,中国电信集团有限公司网络和信息安全管理部总经理谷红勋指出了一个基本事实:“无安全不智能”——没有安全保障的AI越强,风险越大。

他主张企业要构建全生命周期AI安全防护体系,从模型研发、训练数据准备、模型部署、运行监控到退役的每一个环节,都要有对应的安全措施。

赛尔网络有限公司总经理王岩则关注到一个具体问题:面对智能体风险溯源难、责任界定模糊等问题,可借鉴互联网治理机制,为智能体分配唯一网络标识,实现可识别、可追责、可管理。

这意味着,未来每个AI Agent可能都需要一个类似”身份证”的标识,类似于网站的ICP备案。一旦出现问题,可以追溯到具体的AI系统和运营者。

硬件是AI安全的末端防线。 海光信息技术股份有限公司副总裁应志伟提到,算力爆发式增长与安全防护滞后形成落差,需强化机密计算等硬件能力,实现数据全链路加密,从底层守护模型与数据安全。

五、国际协作:全球挑战需要协同破局

AI安全治理面临的很多挑战是跨国界的。

巴基斯坦信息安全协会主席阿玛尔·贾弗里认为,传统被动安全模型已失效,AI让主动防御成为可能,面对勒索软件、供应链攻击等威胁,全球必须实时协同、跨国联动,协同合作是应对网络安全未知挑战的关键。

作为国际都市,香港正以灵活的框架平衡AI创新与监管。香港特区政府署理数字政策专员张宜伟提到,当地已发布伦理AI框架与生成式AI应用指南,并将通过普及AI素养、联动相关国际组织等多元举措,筑牢本地安全防线。

中国的AI安全治理框架在国际上也获得了关注。 框架2.0明确统筹发展与安全,覆盖全生命周期技术应对与综合治理措施,为全球治理提供中国方案。

六、评测即治理:技术治理的新思路

清华大学刘奕群教授提出的”评测即治理”思路值得深入探讨。

传统的安全治理往往是”事后补救”——出了问题再追责、再修复。但AI系统的复杂性使得事后补救往往为时已晚,损失已经造成。

“评测即治理”则是一种”事前预防”的思路:在AI系统上线之前,通过标准化的评测方法,量化评估其安全风险,只有通过评测的系统才能部署。

这意味着,AI安全治理需要建立一套可量化的评测标准和方法论。刘奕群主张以场景化测试赋能人工智能安全——不同场景的AI系统应该有不同的评测标准,评测内容应该涵盖模型的鲁棒性、可解释性、公平性、隐私保护等多个维度。

这种思路已经在一些领域开始实践。例如,美国国家公路交通安全管理局(NHTSA)要求自动驾驶系统在获得上路许可之前,必须通过一系列安全测试,涵盖各种极端场景。

结语:在创新与规范之间找到动态平衡

AI安全治理的根本难题在于:我们希望AI足够强大,能够解决复杂问题;但又希望它足够安全,不会造成新的问题。

这两者之间存在内在的张力。

过于强调安全,可能抑制创新,让AI的发展停滞不前;过于强调创新,可能忽视风险,让社会承受不可控的损失。

吴建平院士的观点或许是我们可以参考的方向:“在创新与规范之间找到动态平衡”——这意味着治理框架需要保持足够的灵活性,能够随着技术的发展而调整,而不是用僵化的规则束缚创新的手脚。

同时,安全治理不能只是政府的责任,技术开发者、企业、学术机构、社会组织都需要参与其中。多方共治,可能是应对AI安全挑战的必由之路。

2026年,AI正在从”工具”进化为”行动者”。如何确保这个新的”行动者”值得信赖,是一个需要持续探索的课题。框架2.0的发布,或许只是一个开始。

相关阅读:

- 《2026世界互联网大会亚太峰会:越”智能”越要”安全”》

- 《人工智能安全治理框架2.0》全文

发表回复